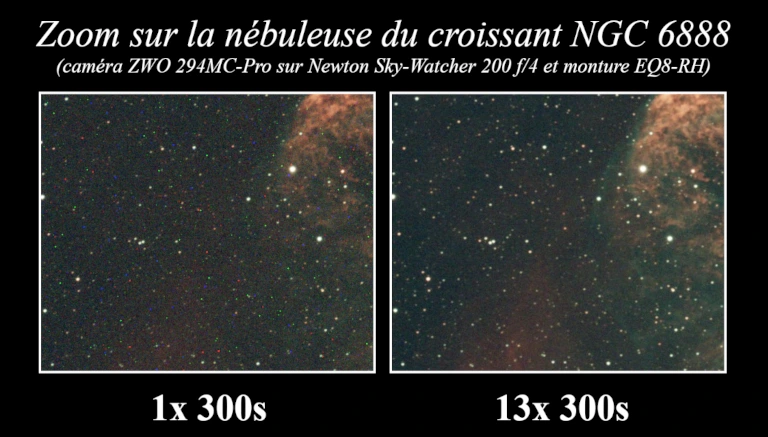

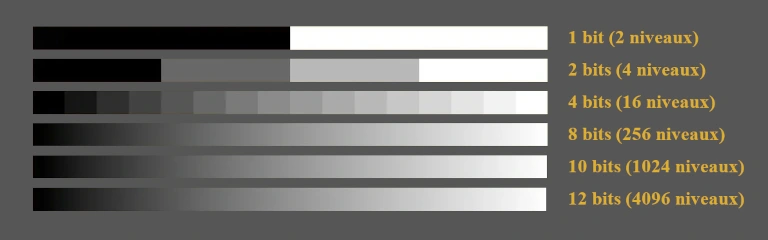

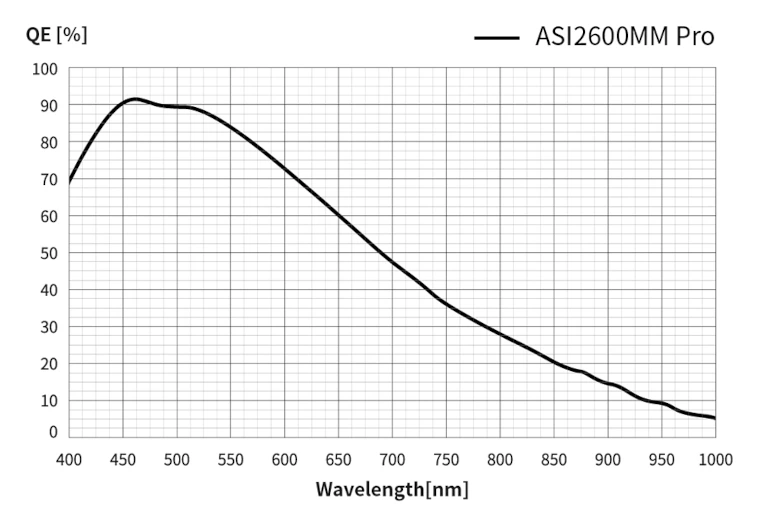

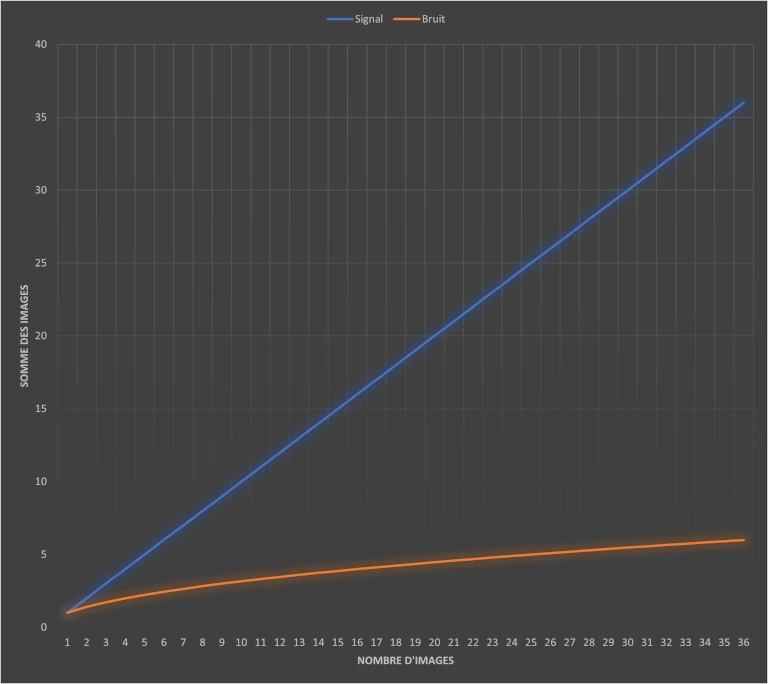

L’intérêt du binning est de regrouper des pixels voisins (exemple du binning 2x2 pour former un seul « gros » pixel) pour augmenter le rapport signal sur bruit (SNR). Sur un capteur CCD, on le lit 1 seule fois après le regroupement. Le bruit de lecture sera donc le même pour 1 ou 4 pixels. Comme le signal est augmenté par 4 (par addition des 4 pixels), le SNR est de 4/1 soit 4 fois plus grand. Sur un capteur CMOS, la lecture des charges se fait dans la structure des pixels avant le regroupement des charges. Chaque pixel génère son propre bruit de lecture.

.

En réduisant le nombre de pixels on augmente la taille du « nouveau » superpixel et donc l’échantillonnage et la luminosité (somme des 4 signaux), mais peu notre crucial SNR. Avec un CMOS le binning software permet d’augmenter le rapport SNR en racine carrée du nombre de pixels « binnés » (binning 2x2 software : gain 2x seulement). On peut faire un binning logiciel avec un CMOS mais ce n’est pas aussi performant, et donc pertinent que du « vrai » binning CCD.

Mon compte

Mon compte

Panier

Panier